Каково разрешение человеческого глаза (или сколько мегапикселей мы видим в каждый отдельный момент времени)

Очень часто фотографы, а иногда и люди из других специальностей, проявляют интерес к собственному зрению.

Вопрос, казалось бы, простой на первый взгляд… можно погуглить, и всё станет ясно. Но практически все статейки в сети дают либо «космические» числа — вроде 400-600 мегапикселей (Мп), либо это и вовсе какие-то убогие рассуждения.

Поэтому постараюсь кратко, но последовательно, чтобы никто ничего не упустил, раскрыть эту тему.

Начнём с общей структуры зрительной системы

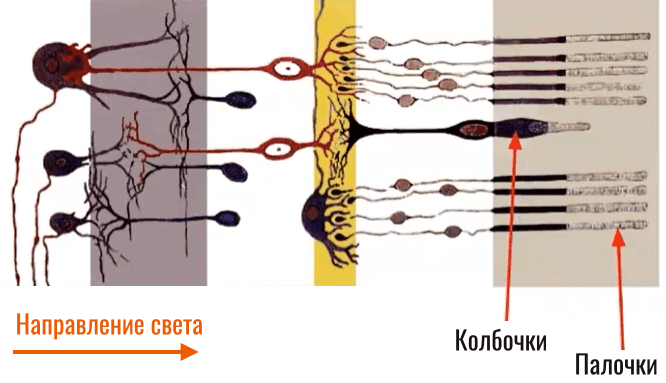

Сетчатка состоит из трёх типов рецепторов: палочки, колбочки, фоторецепторы(ipRGC).

Нас интересуют только колбочки и палочки, так как они создают картинку.

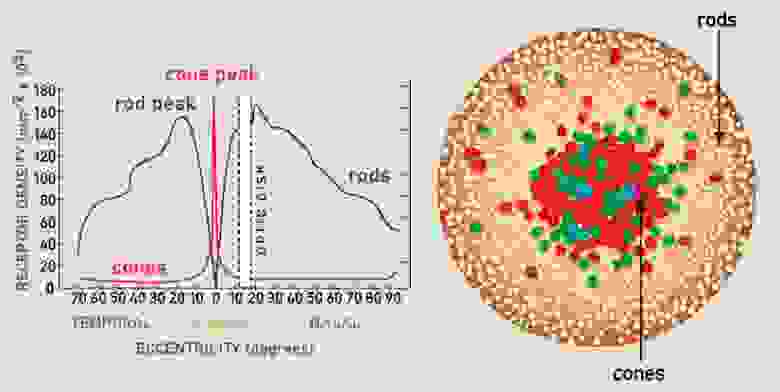

Плотность распределения палочек и колбочек в сетчатке.

Палочки отвечают за восприятие яркости/контраста. Наибольшая плотность палочек — примерно по-середине между центральной ямкой и краем сетчатки.

Интересный факт — многие из вас замечали мерцание старых мониторов и телевизоров при взгляде на них «боковым зрением», а когда смотрите прямо, то всё отлично, было, да?)

Это происходит по причине наибольшей плотности палочек в боковой части сетчатки. Чёткость зрения там паршивая, зато чувствительность к изменению яркости — самая высокая.

Как раз эта особенность и помогала нашим предкам быстро реагировать на самые мелкие движения на периферии зрения, чтобы тигры не пооткусывали им задницы)

Итак, что мы имеем — сетчатка содержит суммарно около 130 Мп. Ура, вот и ответ!

Нет… это только начало и цифра далека от верного значения.

Вернёмся снова к центральной ямке fovea.

Колбочки в самой центральной части ямки «umbo» имеют каждая свой аксон (нервное волокно).

Т.е. эти рецепторы, можно сказать, самые приоритетные — сигнал от них почти напрямую поступает в зрительную кору мозга.

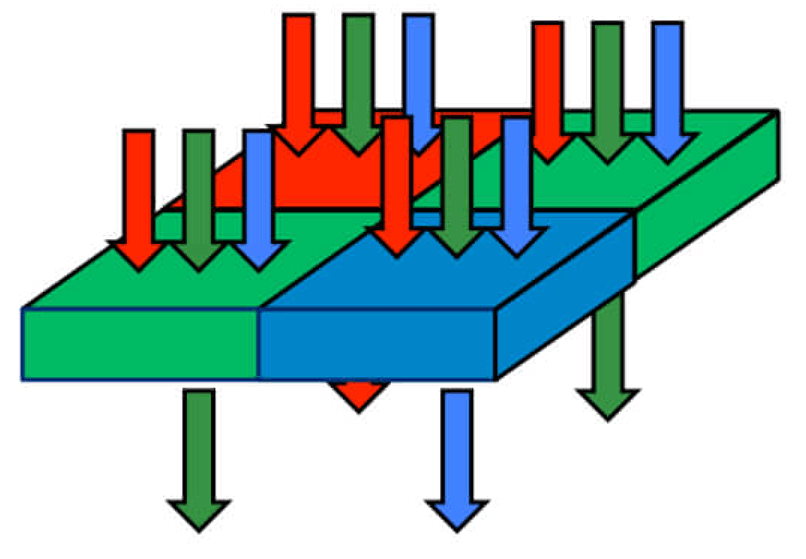

Колбочки, расположенные дальше от центра, уже собираются в группы по несколько штук — они называются «рецептивные поля».

Например, 5 колбочек соединяются с одним аксоном, и дальше сигнал идёт по зрительному нерву в кору.

На этой схеме как раз показан случай такой группировки нескольких колбочек в рецептивное поле.

Палочки, в свою очередь, собираются в группы по несколько тысяч — для них важна не резкость картинки, а яркость.

Итак, промежуточный вывод:

130 миллионов рецепторов превращаются за счёт группировки в 1 миллион нервных волокон (аксонов).

Да, всего один миллион!

В фотиках матрицы по 100500 мегапикселей, а наши глаза всё равно субъективно круче!

Сейчас и до этого доберёмся)

Значит, 130 Мп превратились в 1 Мп, и мы каждый день смотрим на мир вокруг… хорошая графика, не так ли?)

Есть пара инструментов, помогающих нам видеть мир вокруг почти постоянно почти чётким:

1.Наши глаза совершают микро- и макросаккады — что-то типа постоянных перемещений взгляда.

Макросаккады — произвольные движения глаз, когда человек рассматривает что-то. В это время происходит «буферизация» или слияние соседних изображений, поэтому мир вокруг нам кажется чётким.

Микросаккады — непроизвольные, очень быстрые и мелкие (несколько угловых минут) движения.

Они необходимы для того, чтобы рецепторы сетчатки банально успевали насинтезировать новых зрительных пигментов — иначе поле зрения просто будет серым.

Начну с примера — когда мы читаем что-то с монитора и постепенно крутим колёсико мышки для перемещения текста, то текст не смазывается… хотя должен) Это очень занятная фишка — здесь в работу подключается зрительная кора.

Она постоянно держит в буфере картинку и при резком смещении объекта/текста перед зрителем быстро смещает эту картинку и накладывает на реальное изображение.

А как же она знает, куда смещать?

Очень просто — Ваше движение пальцем по колёсику уже изучено моторной корой до миллиметров… Зрительная и моторная области работают синхронно, поэтому Вы не видите смаза.

А вот когда кто-то другой крутанёт колёсико. )

Зрительный нерв

1 Мп (от 770 тысяч до 1,6 млн пикселей — кому как повезло), дальше нервы с левого и правого глаз пересекаются в оптической хиазме — это видно на первой картинке — происходит смешение аксонов примерно по 53% с каждого глаза.

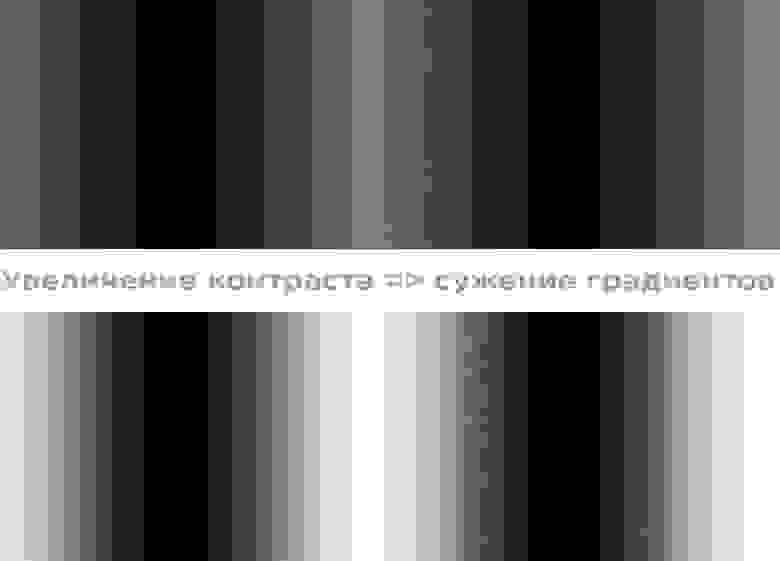

В таламусе происходит, можно сказать, первичная «ретушь» картинки — повышается контраст.

Далее сигнал из таламуса поступает в зрительную кору.

И здесь происходит невероятное количество процессов, вот основные:

В этом и заключается суть феноменологии зрения — у вас ОДНА зрительная система. Вы не можете посмотреть на свою же картинку со стороны.

Если бы человек обладал двумя зрительными системами и по желанию мог переключиться с системы 1 на систему 2 и оценить как работает первая система — тогда да, ситуация была бы печальная 🙂

Но имея одну зрительную систему ВЫ сами и являетесь этой картинкой, которую видите!

Зрительная кора сама осознаёт процесс зрения. Перечитайте это несколько раз.

При травме первичной зрительной коры человек не понимает, что он слеп — это называется анозогнозия, т.е. картинку он совершенно не видит, но при этом может нормально ходить по коридору с препятствиями(первая ссылка в списке).

Здесь я сделаю небольшое отступление и дам краткое пояснение, почему же свет, проходя через роговицу, хрусталик, стекловидное тело и все слои нейронов сетчатки не искажается так сильно, как мы предполагаем. Если сравнивать чистоту и степень аберраций, то нашему глазу далеко до хорошей оптики в современной фото-видео технике.

Всё дело в рецептивных полях — РП (имеются ввиду поля в сетчатке, ЛКТ и отделе коры V1). Одна из задач РП — увеличение микро-контраста изображения. Сетчатка получает слегка размытую картинку, а после этого в процессе нескольких этапов повышения контраста мы видим вполне детализированное изображение. Сама суть увеличения контраста состоит в сужении градиентов, как на примере ниже:

Завершая эту, надеюсь, краткую и понятную статью, хочу напомнить — мы все имеем картинку в

1 Мп… живите с этим 🙂

Литература:

Дэвид Хьюбел — «Глаз, мозг, зрение»

Стивен Палмер — «От фотонов к феноменологии»

Баарс Б., Гейдж Н. — «Мозг, познание, разум»

Джон Николлс, А. Мартин, Б. Валлас, П. Фукс — «От нейрона к мозгу»

Майкл Газзанига — «Кто за главного?»

UPD: поступило заметное количество комментариев/вопросов про цветоощущение. Если эта тема интересна — напишите тег #цветоощущение — займусь созданием статьи.

UPD:UPD: Статья про цвет

Глаз человека против матрицы смартфона: мегапиксели, разрешение и не только!

Сегодня у нас будет необычное, но интересное сравнение двух «устройств» для захвата изображения — матрицы смартфона и человеческого глаза.

Если вы думаете, что современная матрица какого-нибудь Redmi Note 10 Pro на 108 Мп (см. наш обзор) во всём уступает глазу, тогда вы сильно ошибаетесь. Эта статья не только позволит вам лучше понять современные мобильные технологии и то, как они будут развиваться дальше, но и по-другому взглянуть на себя.

Конечно, может показаться, что до сих пор ни одна даже профессиональная камера и близко не подошла к возможностям человеческого глаза. А камеры смартфонов — и подавно!

Посудите сами, сколько же должно быть мегапикселей в камере, чтобы она выдала огромную фотографию, заполняющую всё поле зрение и при этом настолько высокого качества, чтобы мы не увидели ни единого отдельного пикселя?

Ведь глаза выдают нам резкую картинку без пикселей. А значит, разрешение «матрицы» нашего глаза (сетчатки), стало быть, запредельно высокое.

Давайте с разрешения и начнем!

Сколько мегапикселей в глазу?

Задав этот вопрос поисковику Google на английском языке, вы получите в ответ конкретную цифру — 576 мегапикселей. Спросив то же, но уже на русском, ответ будет звучать иначе — около 120 Мп. А если бы на этот вопрос отвечал Стив Джобс, он, вероятно, назвал бы цифру

350 Мп.

Несмотря на то, что все ответы отличаются, они, как минимум, «доказывают», что ни одна современная матрица пока не способна приблизиться к возможностям нашего глаза!

Но почему, собственно, ответы разные? Всё дело в том, что эти расчеты не имеют отношения к реальному устройству глаза.

Глаз на 576 Мп

Представьте, что перед вами огромный экран, который закрывает собой всё ваше поле зрения, то есть, вы не видите ничего, кроме этого экрана. Так вот, для того, чтобы вы не смогли разглядеть отдельные точки на таком дисплее, он должен содержать минимум 576 миллионов пикселей.

Много это или мало? Судите сами: современные 4k телевизоры содержат чуть больше 8 млн пикселей, а ультра-современные 8K-телевизоры могут содержать до 30 млн пикселей и больше! Согласитесь, цифра 576 млн звучит в этом контексте очень убедительной.

То же касается и 350 Мп. Просто при расчете учитывается не самое лучшее зрение, а что-то ближе к средне-статистическому (чем острее зрение, тем больше нужно пикселей в экране и наоборот).

Но какое отношение эти цифры имеют к глазу? Если бы глаз действительно «делал снимки» с разрешением 576 Мп, а затем показывал их нашему сознанию, тогда бы можно было говорить о таком высоком разрешении. Однако в реальности ничего подобного не происходит.

Глаз не делает таких «фотографий», поэтому и цифры вроде 576 или 350 Мп можно отбрасывать сразу. Они вообще не отвечают на поставленный вопрос и не имеют никакого отношения к зрению.

120-мегапиксельный глаз

Это уже более интересная и правдоподобная цифра, которая, впрочем, также не имеет отношения к правильному ответу.

Как и матрица смартфона, «матрица» глаза (сетчатка) состоит из отдельных крохотных светочувствительных элементов. В камере мы называем их пикселями, а на сетчатке — палочками и колбочками (есть еще третий вид «пикселей», но в формировании картинки они не принимают участия).

Количество палочек на сетчатке — от 110 до 120 млн, а колбочек — 6-7 млн. Получается, общее количество светочувствительных элементов — 116-127 млн, что и дает нам те самые усредненные 120 Мп.

Пока что остановимся на этой цифре. Тем более, что она очень близка к современным 108-Мп матрицам смартфонов.

А теперь давайте сравним эти «матрицы».

108-Мп камера смартфона против 120-Мп глаза. Чья матрица лучше?

Любая мобильная матрица со сверхвысоким разрешением (от 48 Мп и выше) устроена примерно одинаково. Это прямоугольная пластинка, на которой размещаются те самые «пиксели» небольшими группами.

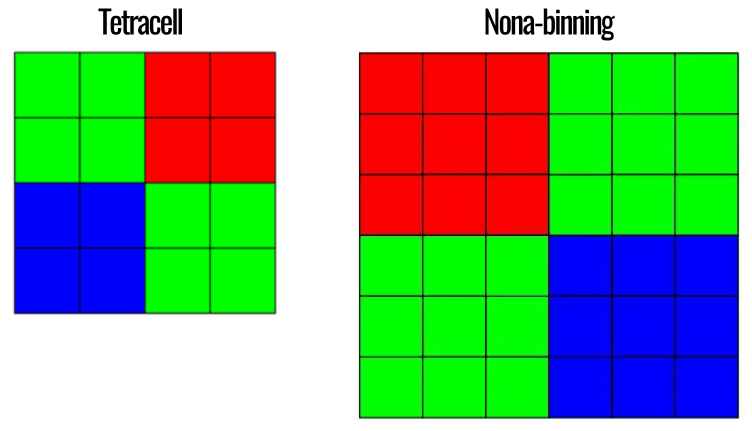

Дело в том, что пиксели не способны воспринимать цвет, поэтому над каждым из них нужно дополнительно разместить фильтр — стекляшку, окрашенную в один из 3 основных цветов. И когда весь свет от объектива проходит через такой фильтр, на пиксель попадает только его часть определенного цвета:

То есть, мы как бы раскладываем весь поступающий свет на составляющие части: красную, зеленую и синюю. У нас получается мозаика из 3 цветов. А затем, когда нужно восстановить оригинальный цвет на фотографии, мы снова собираем эти составляющие части в один цвет. Или, говоря профессиональным языком, делаем демозаику.

Но в матрицах с высоким разрешением «стекляшка» (фильтр) устанавливается не над каждым пикселем, а сразу над группой пикселей. Например, в первой 108-Мп матрице Samsung HMX цветные фильтры накрывали сразу 4 пикселя (технология Tetracell), а уже во второй версии Samsung HM1 — 9 пикселей (технология Nona-binning):

И в таком объединении пикселей некоторые пользователи видят подвох. Ведь фактически, если считать по цветам, то у нас нет 108 мегапикселей. Матрица Tetracell выдает 27 Мп (108/4), а Nona-binning вообще видит только 12 цветных мегапикселей (108/9).

Конечно, в реальности всё сложнее, так как есть много алгоритмов и вариантов получить гораздо больше цветов, по-разному складывая пиксели. Но этот подвох — сущий пустяк в сравнении с тем, как устроена «матрица» глаза!

Реальный размер «матрицы»

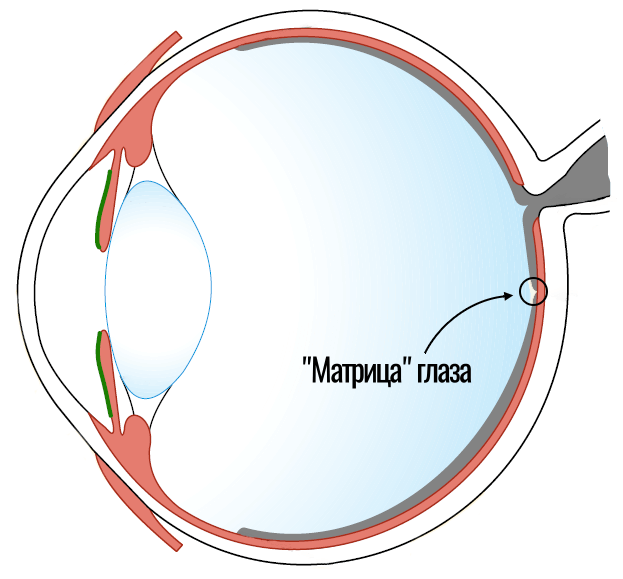

Сетчатка глаза (аналог матрицы) не прямоугольная, как в камере смартфона, а сделана в виде «полусферы», растянутой на задней внутренней стенке глазного яблока:

На иллюстрации выше сетчатка показана серым цветом. С учетом того, что она покрывает около 72% всей площади глазного яблока, мы получаем просто гигантскую матрицу в сравнении с матрицей смартфона. Даже если речь идет о самой крупной 108-Мп матрице, ее площадь минимум в 10-14 раз меньше сетчатки.

Но если со смартфоном весь подвох заключался в объединении пикселей, то с глазом всё куда серьезнее.

Начнем с того, что за цвет отвечают только «пиксели» под названием колбочки, которых в глазу не более 7 млн. То есть, даже чисто теоретически наш глаз способен выдать цветную картинку в разрешении всего 7 Мп. А это уже даже не уровень 4K!

Вы можете себе представить огромную фотографию, занимающую всё поле зрения, которая состоит всего лишь из 7 Мп? Конечно же, с таким низким разрешением размер матрицы уже не играет никакой роли. Снимки будут в любом случае отвратительного качества.

Но почему же тогда картинка, которую мы видим, настолько чёткая?

Всё дело в том, что большая часть колбочек (цветных светочувствительных «пикселей») собрана в крохотной ямке по центру сетчатки. Здесь же полностью отсутствуют палочки («пиксели», воспринимающие только яркость). Фактически, «матрица» нашего глаза, фиксирующая максимально четкое цветное изображение, выглядит вот так:

Согласитесь, теперь уже смартфон кажется куда более серьёзным и качественным инструментом на фоне этого незначительного кусочка сетчатки.

И только в этом месте изображение на сетчатке максимально резкое. Это примерно кусочек изображения 2×2 см на расстоянии вытянутой руки. Вся остальная картинка очень размыта и чем дальше от этого центрального кусочка, тем плачевнее ситуация.

Естественно, это справедливо именно для одного «снимка». Если вы захотите проверить эту информацию и посмотреть чуточку левее, то уже в этой точке будет максимальная резкость, а участок правее окажется смазанным. Просто ваших глаза сфокусируют новую область изображения на центральную ямку.

Но и это еще не все!

«Биннинг пикселей» на матрице глаза

Как уже было сказано выше, на мобильных матрицах пиксели объединяются в группы по 4 или 9 штук. Эта технология называется биннингом пикселей и главная ее цель — улучшить качество снимка, сократив количество шумов.

Точно такая же технология используется и в «матрице» нашего глаза. Только там объединяются не 4 или 9 «пикселей» в одну нервную клетку, а десятки, сотни и даже тысячи палочек и колбочек! Если брать в среднем, то можно считать, что «пиксели» глаза объединяются по 100 штук.

И здесь, в отличие от смартфона, мы имеем дело с реальным физическим объединением сигнала. То есть, мы не можем считать сигнал с одной палочки, которая объединена в группу из 1000 палочек/колбочек. Считывается только общий сигнал всей группы (как одна точка). Просто у нас физически только около миллиона «проводков», выходящих из глаза и идущих в мозг.

На смартфоне же каждый пиксель подключен отдельным проводом и мы считываем по отдельности каждый из 108 миллионов пикселей, даже если собраны в группы и накрыты одним цветным фильтром. А объединение сигнала происходит уже после его считывания. Таким образом:

Реальное разрешение глаза приближается к цифре в 1.3 Мп! А это уровень кнопочного телефона 15 летней давности…

И практически вся эта детализация уходит на крошечный «центр кадра», так как именно в центральной ямке колбочки не объединяются в группы, чтобы картинка оставалась максимально четкой.

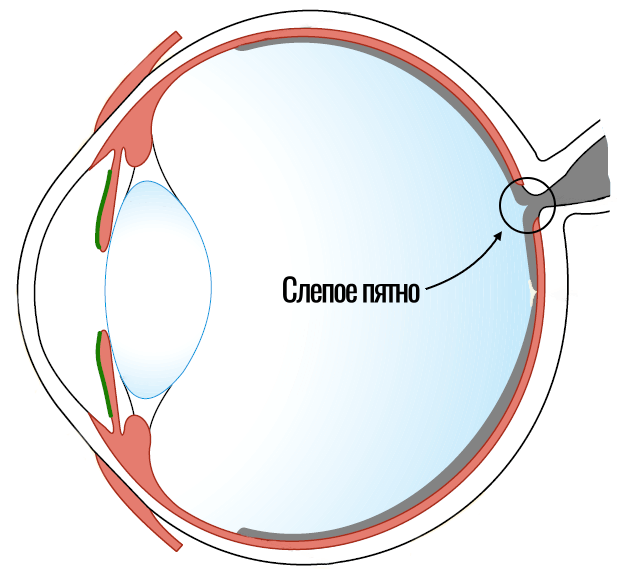

Дыра в матрице!

Казалось бы, что еще можно придумать, чтобы испортить матрицу глаза? Может добавить «мертвые зоны» на матрицу? Так и есть!

Примерно по центру каждого глаза, недалеко от главного резкого участка (центральной ямки), находится место, куда выходят все «провода» (аксоны) от наших пикселей и одним общим «кабелем» (оптический нерв) идут в мозг:

В этом месте нет никаких светочувствительных элементов и поэтому «слепые пятна» находятся прямо у нас перед глазами.

Если вы читаете эту статью с монитора компьютера (с большого экрана), тогда просто закройте, например, правый глаз и посмотрите левым глазом с расстояния

20-30 см на плюсик, изображенный справа. В этот момент огромный черный кружок слева просто исчезнет, так как он попадет прямо на слепое пятно:

Естественно, вы не должны никуда переводить взгляд, иначе глаз снова проделает свой трюк — сфокусирует эту область в центральную ямку.

Можно поступить еще проще. Вытяните левую руку вперед и посмотрите левым глазом на свой большой палец, выставленный вверх. Теперь не отводя взгляд в сторону, медленно отводите руку в лево и в какой-то момент (где-то левее на 20 см от центральной точки) большой палец просто исчезнет, попав в «слепую зону».

Эти слепые пятна на глазах присутствуют постоянно, но когда мы смотрим двумя глазами — правый глаз добавляет картинку в слепое пятно слева и наоборот. А когда смотрим только одним глазом, мозг пытается как-то незаметно зарисовать пятно чем угодно, например, цветом, окружающим слепое пятно).

Но и это еще не все! Не забывайте, что сетчатку глаза нужно как-то питать, а значит на ней должны быть сосуды. Эти сосуды действительно есть, и они отбрасывают тень на «фотографию». Но мы не видим эти тени, так как мозг к ним уже давно привык и понял, что их нужно не показывать сознанию, а зарисовывать, как в фотошопе.

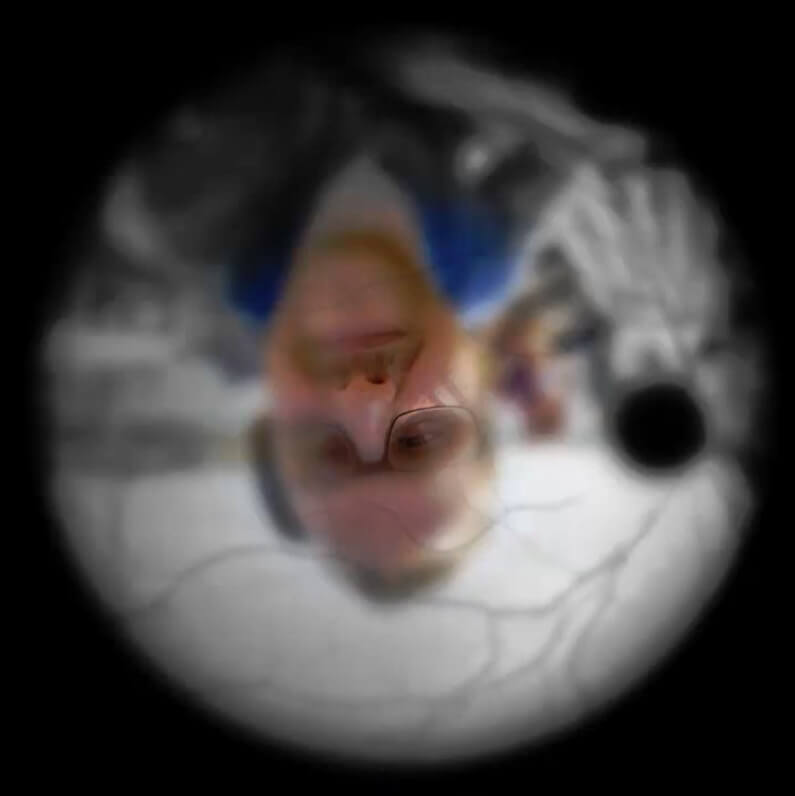

Думаю, теперь вы готовы увидеть пример снимка, который выдает 1.3-Мп матрица глаза. Если вы ожидали увидеть качество хотя бы на уровне кнопочной Nokia 15-летней давности, то всё еще хуже:

Конечно, это лишь наглядный пример, сделанный на компьютере, но он хорошо передает основной смысл.

Мы видим маленькую четкую область по центру, слепое черное пятно справа, тени, отбрасываемые сосудами. И крайне низкое качество 1.3-Мп снимка. Да и цвета по краям практически отсутствуют, так как там мало колбочек и много палочек. Единственный нюанс — здесь не показан нос, который постоянно присутствует в кадре и мешает просмотру, но мозг его «вытирает» на снимках.

А еще забавный факт заключается в том, что мобильные телефоны уже давно перешли на технологию BSI, суть которой заключается в том, что вся обвязка пикселей (провода) размещается позади светочувствительных элементов. То есть, ничего не препятствует движению света:

Но глаз был разработан гораздо раньше появления технологии BSI. Поэтому здесь светочувствительные элементы находятся в самом низу, за несколькими слоями проводов (нервов) и других клеток (по большей части прозрачных):

И прежде, чем мы поймем почему же вопреки всему этому мы видим окружающий мир так хорошо, давайте еще сравним производительность матриц при плохом освещении.

Матрица смартфона против сетчатки при плохом освещении

Когда света становится очень мало, каждый фотон на счету! Фотон — это мельчайшая неделимая порция света. На матрицу смартфона или сетчатку не может упасть половина или четверть фотона.

Когда фотон поглощается пикселем матрицы, кусочек кремния высвобождает 1 электрон (подробнее). Чем больше фотонов поглотится, тем больше электронов появится. А чем больше электронов — тем ярче будет эта точка на итоговом снимке.

И здесь важно использовать все фотоны максимально эффективно. То есть, желательно, чтобы каждый фотон, попавший на пиксель, привел к появлению электрона. Хотя это не всегда так.

Представьте, насколько ужасной была бы матрица, поглощающая только каждый десятый фотон?! Их и так очень мало при плохом освещении, а здесь еще и 90% фотонов просто тратятся впустую.

Знаете ли вы какая эффективность современных матриц на 64 или 108 мегапикселей? Примерно 120%! То есть, если на матрицу попадает 100 фотонов, они могут «создать» до 120 электронов. Это превосходный показатель.

А теперь посмотрим на наш глаз. Чтобы активировать хотя бы одну колбочку («цветной пиксель»), нужно гораздо больше фотонов, чем требуется для активации одной палочки («пиксель», учитывающий только яркость). Поэтому в темноте недостаточно света для активации колбочек и мы «делаем снимки» только черно-белыми палочками.

Если в матрице смартфона фотоны поглощают кусочки кремния, то в палочках этим занимаются специальные молекулы под названием родопсин. Одна молекула родопсина может поглотить 1 фотон света.

Вот как выглядит такая палочка:

Обратите внимание на «полку» с дисками. В каждом таком диске находится 10 тыс. молекул родопсина. То есть, каждый диск способен поглотить 10 тысяч фотонов. А теперь следите за цифрами:

Итого, «матрица» глаза способна поглотить около 1.2 квадриллиона фотонов (1 квадриллион — это миллион миллиардов). А 108-Мп матрица смартфона с самыми современными эффективными пикселями может поглотить около 600 миллиардов фотонов, что примерно в 2000 раз меньше.

Но проблема в том, что этих фотонов ночью очень мало. Днем такое преимущество дает гораздо лучший динамический диапазон, но как быть ночью?

Всего одного фотона достаточно для того, чтобы активировалась одна палочка. Но эта палочка не отправит никакого сигнала в мозг и мы не увидим картинку. Для этого нужно активировать хотя бы 10 палочек. И здесь мы возвращаемся к вопросу об эффективности «матрицы» глаза.

Если у смартфона она превышает 100%, то для глаза этот показатель не дотягивает и до 20%. То есть, из 100 фотонов, попавших на сетчатку, палочками поглотится в лучшем случае 20 фотонов. Остальное будет «утилизировано» специальным слоем, который предотвращает хаотическое движение фотонов внутри глаза, чтобы не возникало никаких отражений, «засветки» и прочих проблем.

Именно из-за такого поглощения всех «лишних» фотонов наш зрачок кажется черным. Оттуда просто не возвращается свет. А если бы возвращался, мы бы видели кровь в сосудах задней части глаза.

Собственно, иногда это и происходит, когда мы используем вспышку (яркий источник света) при плохом освещении. Зрачки не успевают отреагировать на мощный поток света и прикрыть «диафрагму объектива». Слишком много фотонов залетает в глаз и, отражаясь, вылетает оттуда.

Процессор как секрет успеха! Или что нас ждет дальше?

Возможно, вы уже догадались, что весь секрет качественного изображения заключается в мощнейшем «процессоре» обработки фотографий. Мозг действительно получает плохую картинку, если сравнивать ее с тем, что выдает смартфон.

Но глаза работают не покадрово. Они непрерывно ритмично совершают очень мелкие движения (саккады), сканируя сцену своими жалкими 1.3 мегапикселями.

Мозг объединяет две плоские картинки с двух глаз и строит трехмерное изображение. Он убирает тени от сосудов, силуэт носа, разукрашивает слепые пятна, делает догадки и превращает их в «реальную» картинку.

Чтобы вы осознали масштаб его художественной самодеятельности, скрытой от вашего сознания, просто посмотрите на луну или солнце. Вы замечали, какие они громадные над горизонтом и мелкие в зените?

Бывало ли у вас такое, что вы даже говорили кому-то полюбоваться большой и красивой луной (и желательно сделать это быстрее, пока она не поднялась вверх и не стала маленькой)?

Что же это за такое загадочное физическое явление? Может всё дело в орбитах? Или в атмосфере, которая как-то не так преломляет свет и увеличивает размеры небесных тел?

На самом деле, ни солнце, ни луна никак не изменяют своих размеров, будь они в зените или над горизонтом. Это просто ваш мозг так развлекается, «делая снимок» маленькой луны над горизонтом, а затем в своем «фотошопе» увеличивает ее до захватывающих размеров и демонстрирует результаты своей работы вашему сознанию.

Вы поражаетесь его талантам, звоните знакомым и советуете посмотреть на эту красоту. Но объективно никакой красоты нет. Ваши знакомые посмотрят на крохотную луну, а их мозг точно также «отфотошопит» снимок, сделав луну покрупнее и поэффектнее. И вы вместе насладитесь несуществующим пейзажем!

Просто осознайте весь это сюрреализм.

Те жалкие 1.3 Мп, которые фактически поступают в мозг — это лишь незначительный процент от той картинки, которую мы видим. Всё остальное — это, если так можно выразиться, вычислительная фотография. И именно по этому пути пошло развитие смартфонов.

Разница лишь в том, что смартфон должен делать четким весь снимок, а не только его кусочек в центральной части, как это делает мозг. Поэтому матрица смартфона в целом выдает гораздо более качественное и четкое изображение, нежели сетчатка глаза. И в этом плане технологии давно опередили биологию.

Будет интересно наблюдать за реакцией людей, когда все смартфоны будут проделывать тот же трюк с луной, что и наш мозг. И не только с луной!

Эстеты будут выражать свое недовольство тем, что смартфоны больше не передают реальность, а занимаются ерундой: «Зачем мне фотошоп!? Я хочу видеть натуральный снимок! Где старые-добрые времена, когда в камере была главной физика, а не алгоритмы!?»…

И эти же люди даже не будут догадываться, что «реальность» — это плод их воображения, рисунки, жестко обработанные «фотошопом» мозга.

Алексей, глав. редактор Deep-Review

P.S. Не забудьте подписаться в Telegram на первый научно-популярный сайт о мобильных технологиях — Deep-Review, чтобы не пропустить очень интересные материалы, которые мы сейчас готовим!

Как бы вы оценили эту статью?

Нажмите на звездочку для оценки

Внизу страницы есть комментарии.

Напишите свое мнение там, чтобы его увидели все читатели!

Если Вы хотите только поставить оценку, укажите, что именно не так?

Bluetooth-кодеки и беспроводной звук на смартфоне для «чайников»

Батарея смартфона. Часть 1. Как она работает и как правильно заряжать свой телефон

Фильтр синего света на Android-смартфонах. Разоблачение популярного мифа

Что такое SpO2 и можно ли использовать фитнес-браслеты для измерения уровня кислорода в крови?

Что такое PDAF и Dual Pixel? Или как работает автофокус на смартфонах

OLED-дисплеи: в чем разница между AMOLED и Super AMOLED? Чей экран лучше — Apple или Samsung?

Цветная революция: почему смартфоны с IPS-экранами терпят поражение?

Ах этот субъективный звук! Или как полюбить свои наушники со смартфоном Vivo, Xiaomi или Samsung

После прочтения статьи осталось чувство, что автор не достаточно акцентировал внимание на разнице между задачами сетчатки и матрицы смартфона.

Глазу не нужно чёткое изображение на всём поле видимости потому что у глаза — задача помочь мозгу оценить окружающее пространство. Вот потому глаз и совершает множество движений, тыкаясь то туда, то сюда в окружающую картину мира. Глаз детально рассматривает то, что интересно мозгу. А то что не интересно, присутствует в виде размытой тени или вовсе додумывается и дорисовывается самим мозгом…

Что касается матрицы смартфона, то здесь задача другая. Матрица смартфона служит для детального восприятия и преобразования в электрический импульс отображенной на неё картинки. То есть глаз и сетчатка для «прощупывания» и рассматривания, а матрица смартфона для, в конечной счёте, качественного отображения всей принятой картинки.

Сетчатка может позволить себе быть качественной только в центре, а матрица должна быть качественной на любом участке воспринимаемого и передаваемого изображения.

P.S. Встречал где-то схематическое отображение траекторий движения глаз и взгляда при рассматривании различных изображений.. Довольно интересно, как мужчина рассматривает женщину. Куда он смотрит.. и наоборот, как женщина смотрит на мужчину. Как рассматриваются людьми различные картины, объекты, здания..

На известных полотнах есть места, куда практически почти никто не смотрит.

Добрый день! Возник вопрос по поводу сюрреализма. На фотоснимках луна на линии горизонта реально огромная без какого-либо фотошопа.

прочитала комменты к этому вопросу ниже, не получилось удалить свой вопрос. Сори.

Спасибо. Жду 108-мегапиксельные протезы для глаз, чтобы хоть что-то видеть.

Спасибо за нормальный изложение, без глупостей.

Однако вы недооцениваете глаз:

1. Объединение сигналов от датчиков (палочек и колбочек) происходит с ПЕРЕКРЫТИЕМ, т.е. один датчик участвует в НЕСКОЛЬКО сгруппированных выходных сигналах из глаза. Соответственно, выводы о разрешении глаза у Вас занижены.

2. Помимо больших скачков (саккад, нужных для предотвращения выцветания изображения), глаз делает ещё и мелкие движения — это аналог pixel shift в фотиках. Это приводит к ещё большей недооценке Вами разрешающей способности глаза.

3. Ограничение на пропускную способность кабеля из глаза (примерно соотвествующее vga картинке), скорее всего, преодолевается системой глаз-мозг за счёт динамической РАЗВЁРТКИ от периферии поля зрения к центру. Т.е. одновременно передаются только данные узкого кольца, а не всего поля зрения. Это явление почему-то обойдено вниманием учёными, но множество наблюдений говорят за его реальность (характер альфа-ритма, иллюзии восприятия движения и мерцающих объектов, более быстрая реакция на события на переферии поля зрения и ещё много других).

Учтите, пжст, эти замечания и тогда Ваша статья будет на очень высоком уровне соотвтствия реальности.

Спасибо за дополнение!

Конечно, в статье речь шла именно об «абстрактном кадре», как если бы такой кадр можно было сделать глазом. То есть, зрение рассматривалось не как «непрерывная обработка информации» (чем оно и является), а именно как «гипотетический фотоаппарат», способный дать нам RAW-файл.

Для «чистоты» сравнения я также не учитывал и возможности современных камер, основанных на таком же непрерывном «сканировании» (группировка кадров для улучшения динамического диапазона, различные виды стекинга, супер-разрешение — тот же pixel shift, длинные выдержки, различные приемы с дебайеризацией и пр.).

Что касается первого пункта, не совсем понятно, как это может увеличить разрешение. Если у нас есть строго определенное количество выходящих аксонов (от 0.8 до 1.7 миллионов или 0.8-1.7 «мегапикселей») и мы говорим о гипотетическом снимке, то каким образом связь одного фоторецептора с несколькими ганглионарными клетками (результирующими «мегапикселями») помогут увеличить разрешение? Другими словами, что толку от того, что мы в один «пиксель» вместим информацию со множества фоторецепторов? Ведь в итоге мозг обработает всю эту информацию, как «одну точку» (пришел сигнал с одного аксона)?

До мозга (того, который ЗА глазом) простые точки же не доходят. Туда приходит результат обработки, сильно отличающийся от rgbw-интенсивностей.

Возьмём, для примера, ганглиозную клетку первого же слоя обработки в глазу, которая определяет on-off поля — т.е. показывает, что сигнал внутри кружка из 100 рецепторов ярче, чем сигнал по периметру кружка. Если мы будем пространственно располагать эти кружки со сдвигом на один рецептор, то чёткость вообще не упадёт, т.к. количество таких ганглиозных клеток, собирающих по 100 сигналов, всё равно будет сравнимо с числом рецепторов. Этот пример — просто иллюстрация.

Сколько таких on-off полей в реальной сетчатке я не помню. Нужно читать справочники. Однако, вряд ли сильно меньше, чем рецепторов.

Ещё, насколько я помню, в глазу вычисляются цветоразностные сигналы, линии разной направленности (для каждого угла линии свой нейрон) и ещё чего то — всего, кажется, 5-6 слоёв обработки.

Как правильно сравнивать весь этот пучок информации по чёткости — это, похоже, не совсем тривиальная задача.

Точно помню, что есть парадокс чёткости глаза — человек может видеть чётче, чем показывают рассчёты для глаза. Например, первых космонавтов учили различать различные объекты на земле (для разведывательных целей). И они каким то образом классифицировали видимые объекты угловым размером меньше чем угловое расстояние между рецепторами в глазу. Т.е. не просто видели их, а именно классифицировали.

Есть опыты, которые позволяют выяснить, что люди видят разницу в освещённости в один фотон (на сколько то там милисекунд).

Всё это наводит на мысли, что нифига возможности глаза, как элемента системы, не сводятся к возможностям целой системы.

Вы затронули интересную тему с рецептивными полями, которая в статье не раскрыта. И Вы полностью правы в том, что зрение устроено гораздо сложнее современных камер.

Но даже если не брать во внимание тот факт, что размеры рецептивных полей сильно различаются в размерах (только в центре они самые маленькие) и даже если предположить, что их очень много и благодаря этому очень круто работает выделение контрастных границ, даже если брать все рецепторы по отдельности без их объединения (а «цветных» рецепторов и так очень мало, да и те почти все собраны в одном небольшом участке), то «матрица» глаза всё равно будет очень сильно уступать матрице фотоаппарата (если мы говорим о чисто гипотетической возможности сделать один снимок).

Это легко проверяется на практике — достаточно просто зафиксировать взгляд на любой точке и попытаться рассмотреть объекты по сторонам (можно даже в нескольких сантиметров от центральной точки) — они все будут размыты.

То есть, глаз «как фотоаппарат» (чем он, конечно же, не является) — крайне плохая штука в сравнении с камерой смартфона. Именно это хотелось показать в статье.

Но, признаюсь, после Ваших дополнений захотелось подробно рассмотреть работу глаза именно как глаза, а не «фотоаппарата». Поставлю галочку.)

Давно и с огромным интересом читаю ваш канал, не перестаю восхищаться вами. Респект и уважение вам! Спасибо за вашу работу

Большое спасибо за добрые слова!

Если большая Луна это — плод нашего мозга, то, если в этот момент сделать фотографию Луны, что получим? Она будет маленькой (нормальной)? Сомневаюсь. Или глядя на фото наш мозг будет продолжать проделывать свои трюки? Ну и ещё сомнительно, что у всех людей фотошоп в голове работает вот так синхронно, что ВСЕ видят именно большую Луну.

Всё верно. Когда луна кажется очень большой, достаточно сделать фотографию и убедиться, что она крошечная и совершенно невзрачная на снимке. И здесь уже мозг ничего не будет дорисовывать.

В том, что все видят именно большую луну нет ничего удивительного. Ведь на сетчатку глаза каждого человека падает идентичный по размеру отпечаток луны, вне зависимости от ее положения на небе. И мозг каждого человека «понимает», что так быть не может (когда объект находится на «разном расстоянии», а его размеры на сетчатке не изменяются).

«И в этом плане технологии давно определили биологию.»

Исправьте определили на опередили. Мозг, конечно, додумал, но мало ли..

И спасибо за шикарную статью!

)) Спасибо! Интересная опечатка вышла.

В очередной раз восторг от прочтения 🙂

Было очень познавательно. Интересно, сможет ли наука преодолеть ограничения на количество «проводов», по которым передается картинка в мозг, для повышения ее качества.

Спасибо! На самом деле, количество проводов — не единственная проблема. Плотность колбочек и их диаметр, а также размер зрачка (и как следствие — дифракция света) не позволят значительно увеличить разрешающую способность глаза.

Но об этом подробнее читайте уже сегодня в новой статье, посвященной разрешению экрана смартфона и плотности пикселей на дюйм (ppi)! 🙂

По поводу Луны над горизонтом, слышал что эффект этот получается из-за того, что мы видим у горизонта другие окружающие объекты — деревья, здания и т.д. за счёт чего мозг сравнивая Луну и эти «объекты» в дали, образно увеличивает спутник. А когда поднимается выше, то сравнивать не с чем, поэтому и кажется дальше и меньше.

Верно, Вы используете ключевую фразу «объекты вдали». Но как наш мозг может понять, далеко ли объект находится от глаз или близко? Если я покажу Вам маленькую точную копию автомобиля, Вы легко определите, что это ненастоящий автомобиль, а его крошечная копия. И сделаете Вы это только благодаря контексту — окружающим объектам.

Именно поэтому важен ландшафт, деревья, дома и пр. Только так мы можем понять, что объект находится далеко. Сам размер объекта играет второстепенную роль.

Но дальше Вы мыслите якобы логично, хотя на самом деле происходит ровно обратное. Нам действительно не с чем сравнивать расстояние в небе, так как нет ни ландшафта, ни деревьев или домов, уходящих в глубь космоса. Всё, что у нас есть — это опыт. Мы хорошо знаем по опыту, что облако или воздушный шар над головой крупнее облака или воздушного шара над горизонтом, так как над горизонтом — это дальше.

Если большая Луна это — плод нашего мозга, то, если в этот момент сделать фотографию Луны, что получим? Она будет маленькой (нормальной)? Сомневаюсь. Или глядя на фото наш мозг будет продолжать проделывать свои трюки? Ну и ещё сомнительно, что у всех людей фотошоп в голове работает вот так синхронно, что ВСЕ видят именно большую Луну.

1. Многое в оптике и вычислительной фотографии заимствовано из биологии.

2. И глаза, и смартфоны — не фото-, а непрерывно снимающие видео- камеры.

Отличное изложение! С удовольствием прочитал вашу статью. Вообще рад, что открыл для себя ваш сайт и Телеграм-канал. Спасибо!

Спасибо, Максим! Очень рады новому читателю!

Гениальное изложение фактов, теории, практик (опыта) и мысли!

Я не нашёл в комментариях информацию касательно моего вопроса, который прозвучит так:

А как же тогда объекты на фотографиях луны? Я имею ввиду её разных размеров. Фотоаппарат фотографирует факт, не понимаю.

Спасибо!

Спасибо, Ярослав! Но боюсь, не совсем понял Ваш вопрос.

Если вы говорите о фотографиях, вроде этой:

То здесь просто всё дело в использовании телеобъектива. То есть, луна здесь действительно приближается раз в 10 при помощи оптики. Естественно, вместе с луной пропорционально увеличиваются и здания, которые в реальности находятся очень далеко от фотографа. Но нам кажется, что человек стоял рядом, а не за километры от этого здания.

То, что луна на таких снимках находится прямо за зданиями — это эффект «сжатия перспективы», когда нам кажется, что между зданием и луной нет пространства. Это также заслуга телеобъектива.

Если же Вы спрашивали о чем-то другом, тогда перефразируйте, пожалуйста, свой вопрос.

Алексей, правильно поняли! Благодарю за обширный ответ!

Спасибо, Юрий! Что касается луны и солнца. Если позволите, напишу в комментариях еще одну «статью», чтобы попытаться понятно и наглядно объяснить этот феномен.

Когда мы видим облака, проплывающие над головой и уходящие за горизонт, то естественно над головой они кажутся крупными, а на горизонте (вдалеке) — маленькими. Или когда над нами пролетает воздушный шар, то в небе над головой он крупный, но отдаляясь, уменьшается.

Это не просто «ощущение», это объективная реальность. Облако прямо над головой оставит более крупный «отпечаток» на сетчатке глаза или на матрице камеры, чем облако над горизонтом. И когда мы сделаем фотографию смартфоном, то увидим ту же картинку — облака вблизи будут большими, а над горизонтом — маленькими, так как они банально дальше от нас.

С этим, думаю, всё предельно ясно.

А теперь смотрите, какая проблема происходит с луной или солнцем. Они находятся так далеко от нас, что движение по орбитам никак не влияет на реальный размер. Не важно, будет ли луна находиться в какой-то момент времени на 1-1.5% ближе к нам или дальше, увидеть такую разницу невооруженным глазом невозможно.

И у мозга случается «когнитивный диссонанс». Когда луна находится над горизонтом, «логично» предположить, что она должна быть меньшего размера. Ведь мы это наблюдаем повсюду (облака, воздушный шар, самолеты) — всё, что вдалеке (над горизонтом) гораздо меньшего размера, чем то, что «прямо над головой».

Но на сетчатку глаза от луны над горизонтом падает точно такой же по размерам «отпечаток», как от луны в зените (высоко над головой). Для камеры это не проблема. Если на матрицу упал такой же «след», то на фотографии луна будет одинакового размера, будь она в зените или над горизонтом.

А вот для мозга так дело не пойдет, он слишком много думает. Как один и тот же объект может оставлять на сетчатке отпечаток одного и того же размера, находясь при этом «на совершенно разном от нас расстоянии» («близко» над головой и «далеко» над горизонтом)? Да, объективно расстояние до луны не меняется, но наш мозг не особо волнует объективность. Главное — субъективное ощущение. Мозг ощущает расстояние до луны над горизонтом б ó льшим, чем до луны в зените. Но ведь на сетчатке размер луны — один и тот же.

И теперь можно задать очень простой вопрос. Как один и тот же объект может восприниматься одного размера, находясь то близко, то далеко? Есть только один «логический» ответ — значит, луна, которая находится «далеко» (над горизонтом), просто БОЛЬШЕГО РАЗМЕРА, чем луна, которая находится «ближе» (прямо над головой). Только в этом случае она может оставлять «отпечаток» на сетчатке одного и того же размера.

Представьте, что в метре от вас стоит человек ростом 1.75 м, а позади него (в 50 метрах) стоит другой человек, который воспринимается точно такого же размера. Может ли такое быть на самом деле? Да, и только в одном случае — если человек, стоящий в 50 метрах, ГОРАЗДО выше человека, стоящего в метре от вас. Другого быть не может. Поэтому мы будем воспринимать второго человека более высоким, чем первого. Иначе как бы он мог, находясь в 50 метрах дальше, восприниматься/казаться такого же размера?

Всё дело в воспринимаемом расстоянии до этой луны. Сама луна не изменяется, а вот ПОДСОЗНАТЕЛЬНО кажущееся расстояние до нее — изменяется.